一、TinyML 技术核心概念

1.1 什么是 TinyML?

TinyML(微型机器学习) 是机器学习与嵌入式物联网设备交叉融合的新兴技术领域,专注于在资源极度受限的设备上运行机器学习模型。这些设备通常只有几 KB 到几十 KB 的内存,几 MHz 的主频,以及微瓦级的功耗预算。

1.2 TinyML 的本质特征

TinyML 的核心价值在于将 AI 能力从云端和高性能设备迁移到最边缘的嵌入式终端,实现真正的本地化智能。它不是传统机器学习的简化版,而是针对资源受限环境重新设计的完整技术体系。

1.3 与传统计算模式的对比

| 特性 | TinyML | 云计算 | 传统嵌入式系统 |

|---|---|---|---|

| 计算位置 | 设备本地 | 远程数据中心 | 设备本地 |

| 内存需求 | KB 级别 | GB 级别 | KB-MB 级别 |

| 功耗水平 | 微瓦级 | 瓦级 | 毫瓦级 |

| 响应延迟 | 毫秒级 | 秒级 | 微秒级(固定逻辑) |

| 网络依赖 | 无 | 强依赖 | 可选 |

| 隐私保护 | 极高 | 较低 | 中等 |

| 成本结构 | 硬件成本为主 | 服务费用为主 | 硬件成本为主 |

二、TinyML 的核心技术原理

2.1 模型压缩技术

TinyML 的关键挑战是如何将原本需要 GB 级内存的 AI 模型压缩到 KB 级别,同时保持可接受的精度。主要采用以下技术:

1. 量化(Quantization)

-

原理:将 32 位浮点数权重转换为 8 位整数或更低精度

-

效果:内存占用减少 75%,计算速度提升 4 倍

-

精度损失:通常在 1-3% 范围内,可通过量化感知训练缓解

2. 剪枝(Pruning)

-

原理:移除神经网络中不重要的连接和神经元

-

方法:

-

结构化剪枝:移除整个卷积核或神经元

-

非结构化剪枝:移除单个权重连接

-

-

效果:模型体积可减少 10-100 倍

3. 知识蒸馏(Knowledge Distillation)

-

原理:使用大模型(教师模型)的知识来训练小模型(学生模型)

-

优势:小模型可获得接近大模型的性能

2.2 轻量化模型设计

1. 专用网络架构

-

MobileNet:深度可分离卷积

-

EfficientNet-Lite:优化的卷积结构

-

TinyNet:专为微控制器设计的极小网络

2. 算法选择策略

-

传统机器学习算法:随机森林在某些场景更适合

-

简化神经网络:减少层数和通道数

-

特征工程优化:手工设计有效特征减少模型复杂度

2.3 硬件适配技术

1. 内存优化

-

权重存储优化:使用紧凑的数据结构

-

运行时内存管理:动态分配和回收

-

模型分片加载:大型模型分块加载执行

2. 计算优化

-

定点计算:避免浮点运算的高昂成本

-

专用指令集:利用硬件加速指令

-

并行计算:充分利用 MCU 的硬件资源

三、TinyML 项目实战分析

3.1 项目概述

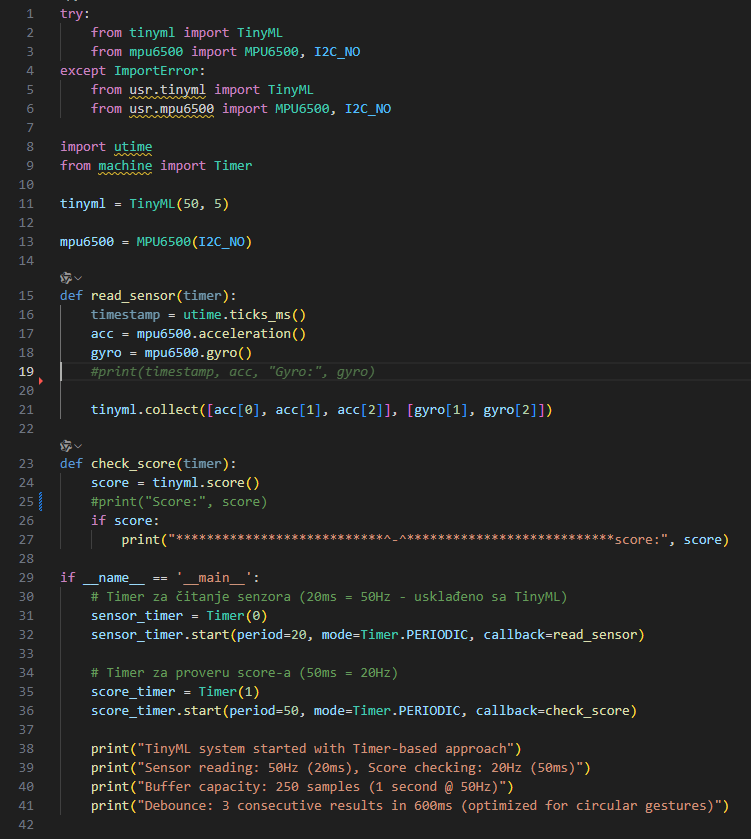

我们将深入分析一个基于 QuecPython 平台的实时手势识别项目,该项目展示了 TinyML 在嵌入式设备上的典型应用。

项目名称:TinyML手势识别系统

硬件平台:QuecPython 开发板,如EG91X_C1_P02开发板

传感器:MPU6500传感器(3 轴加速度计 + 3 轴陀螺仪)

识别目标:4 类手势(0 = 无手势,1-3 = 不同手势类型)

指导文档: Quecpython文档中心

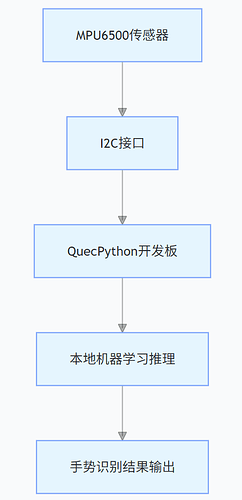

3.2 系统架构设计

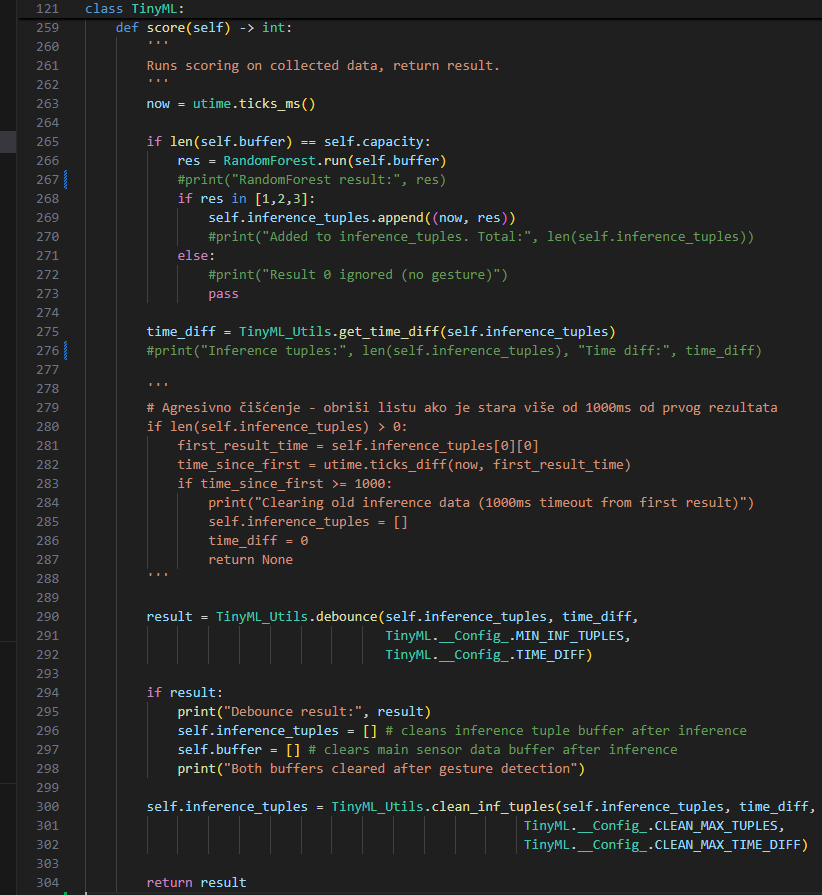

3.3 核心技术实现

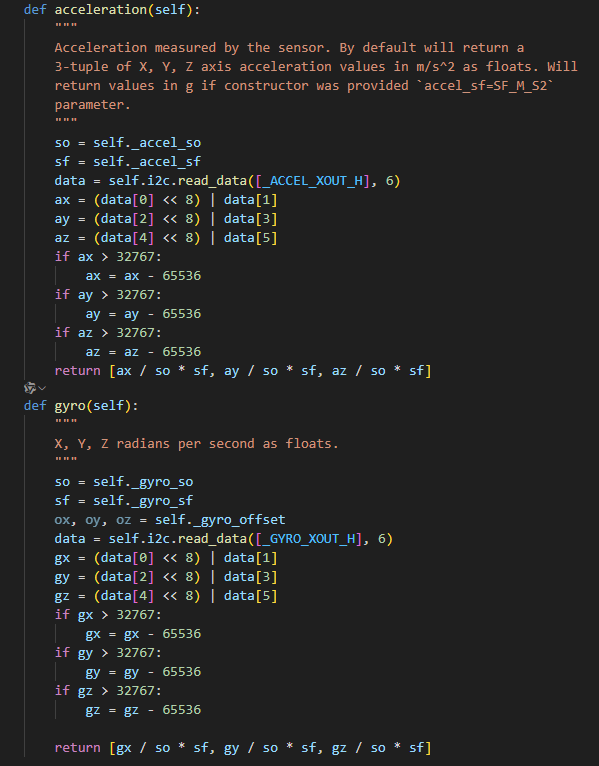

1. 数据采集与预处理

传感器配置:

-

采样频率:50Hz(每 20ms 采集一次)

-

数据格式:加速度计 (m/s²)、陀螺仪 (deg/s)

数据采集:

通过I2c协议读取MPU6500传感器采集的加速度和陀螺仪数据

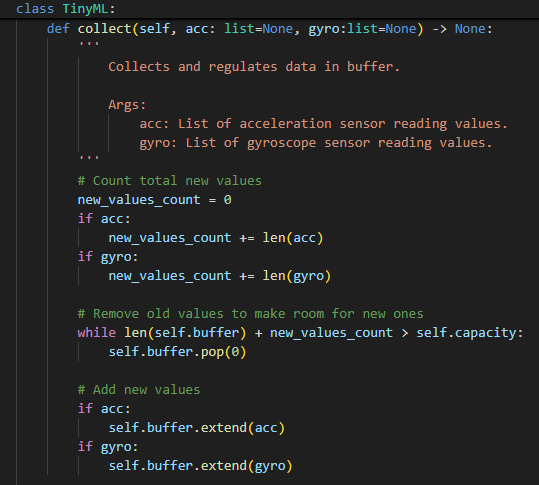

数据缓冲处理:

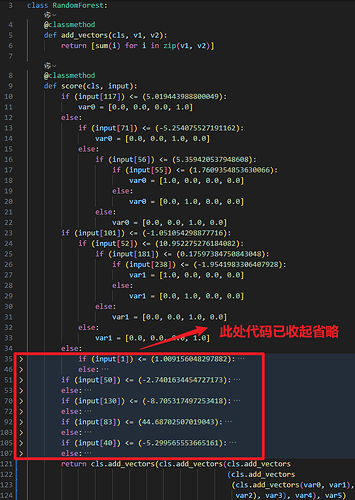

2. 随机森林模型实现

模型优化策略:

-

使用条件判断语句直接实现决策树逻辑

-

避免使用复杂的数学库依赖

-

内存占用控制在 50KB 以内

3. 实时推理与防抖机制

推理触发机制:

-

缓冲区满时自动触发推理

-

防抖处理:需要 3 个连续一致的结果

4. 定时器驱动架构

系统调度设计:

-

使用硬件定时器实现非阻塞数据采集

-

50Hz 传感器数据采集

-

20Hz 模型推理

四、总结与展望

TinyML 作为边缘 AI 的重要分支,正在将人工智能的能力扩展到更广泛的设备和场景中。它不仅是技术的创新,更是 AI 应用模式的革命性变化。

核心要点

-

技术本质:TinyML 是在资源受限设备上运行机器学习模型的技术,通过模型压缩和优化实现本地化智能。

-

关键技术:量化、剪枝、知识蒸馏等模型压缩技术,以及针对嵌入式环境的算法优化。

-

实现模式:从数据采集、模型训练、优化转换到嵌入式部署的完整流程。

-

应用价值:为传统行业带来智能化升级,创造新的产品形态和商业模式。

未来发展展望

-

技术融合:TinyML 将与 5G、物联网、区块链等技术深度融合,构建更智能的边缘计算生态。

-

硬件进步:专用 AI 加速器的普及将进一步提升 TinyML 的性能和效率。

-

开发门槛降低:自动化工具链和可视化编程将使更多开发者能够参与 TinyML 应用开发。

-

应用普及:从智能家居、健康医疗到工业制造,TinyML 将在更多领域得到广泛应用。

TinyML 正处于快速发展期,随着技术的不断成熟和生态的完善,它将成为推动 AI 普及和智能化升级的重要力量。对于开发者而言,掌握 TinyML 技术将在未来的技术竞争中占据重要优势。